Actualmente resulta muy fácil subir videos falsos en plataformas como Facebook o Youtube. Ya es casi imposible incluso para un algoritmo de inteligencia artificial identificar uno. Por fortuna, los gigantes de la tecnología como Google se están aliando contra estas prácticas.

[twitter id_twitter=»https://twitter.com/themusicpimp/status/1194234190621003783″]

La historia de los deepfakes

En el 2017, un usuario de Reedit subió distintos videos manipulados a la plataforma, tan bien hechos que incluso para el usuario normal era casi imposible encontrar las diferencias con uno sin manipular. La calidad de estos videos sube cada año y cada vez es más fácil acceder a los programas para hacerlos. Para muestra, este vídeo del comediante James Meskimen ejemplifica perfectamente la maravilla de los deepfakes.

[video_youtube url_video=»5rPKeUXjEvE» description=»Deepfakes»]

El deepfake recibe su nombre de la técnica con la que se realiza, un tipo de inteligencia artificial llamada deep learning. Esta inteligencia artificial analiza los rasgos físicos de cada rostro y los pega encima de otra, conservando los gestos, como en el caso del vídeo anterior.

Este tipo de tecnología ha avanzado a pasos agigantados a partir del desarrollo del reconocimiento facial, sí, la misma tecnología con la que puedes desbloquear tu celular con sólo mirarlo y deslizar el dedo. A veces, esta tecnología cumple nuestros sueños más locos, como este video que muestra que hubiera pasado si Will Smith hubiera aceptado el papel de Neo en Matrix…

[video_youtube url_video=»1h-yy3h1u04″ description=»¿Qué hubiera pasado si Will Smith hubiera aceptado el papel de Neo?»]

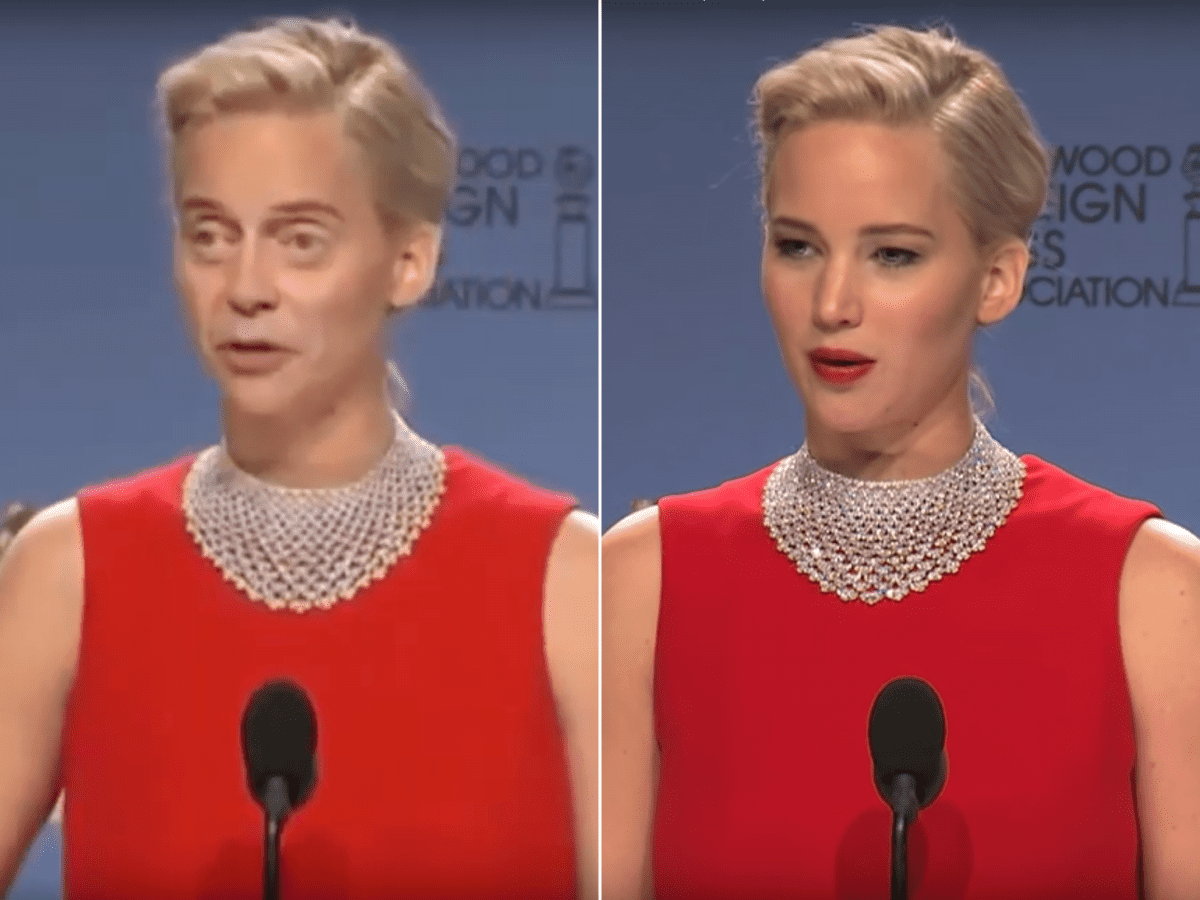

Y aunque pueden utilizarse para trucos como este, las grandes compañías como Google y Facebook prevén que este tipo de manipulaciones pueden dañar la opinión pública en procesos electorales. Recientemente, en redes circula un vídeo con información falsa del candidato Joe Biden, y a principios de este año circuló uno de la presidenta del Congreso de Estados Unidos, Nancy Pelosi. Si este tipo de prácticas sigue, podría desarrollarse hasta convertirse en una gran amenaza para procesos sociales importantes. Por ejemplo, este vídeo muestra la facilidad con que se puede modificar un discurso del ex presidente Barack Obama:

[video_youtube url_video=»cQ54GDm1eL0″ description=»Fake Barack Obama»]

Alianzas para combatir esta tecnología

Se trata de una competencia que ha puesto cara a cara a las inteligencias artificiales, la que genera este tipo de videos y la que se está desarrollando para combatirlos.

FaceForensics es una herramienta generada por investigadores de la Universidad Técnica de Munich y la Universidad Federico II de Nápoles. Generaron alrededor de 1000 vídeos falsos para después introducir esta información a una inteligencia artificial, de modo que ésta se pueda entrenar para reconocer la diferencia entre videos reales y falsos. Sin embargo, para desarrollar este tipo de herramientas se necesita una cantidad inmensa de información. Esta data sólo la poseen los grandes como Google. La empresa ya añadió más de 3 mil videos, realizados en conjunto con 28 actores, a la base de datos de FaceForensics.

Por otro lado, Facebook se alió con Amazon, Microsoft e incluso investigadores del MIT. Ellos apostaron por otra iniciativa, Deepfake Detection Challenge, que como su nombre lo indica, resulta más bien un concurso, en el que ofrecen recompensas en efectivo para los mejores métodos de detección de los mismos. El objetivo es realizar sistemas de inteligencia artificial que detecten pequeñas imperfecciones en video modificados, de manera que confirmen la manipulación de los mismos.

Una cuestión que va más allá de la tecnología

Aunque estos sistemas ya están en desarrollo y cuentan con el apoyo monetario de grandes empresas, el problema no termina ahí. Se trata de una carrera en la que tanto los que falsifican como los que identifican están luchando. La tecnología utilizada para mejorar la IA tendría que actualizarse cada vez que los que manejan este tipo de videos encuentren cómo burlarla.

Por eso, los investigadores sostienen que también se deben de hacer medidas políticas y sociales para contrarrestar los efectos de los videos falsos. Sin embargo, los grandes de la tecnología no han dado señales de tener una postura ante estas medidas.

Facebook aún no ha dicho nada sobre los videos que circulan de la ya mencionada Nancy Pelosi, que fue ralentizadlo en un 75% para hacerla hablar como si estuviera bajo los efectos del alcohol. La empresa tampoco ha desmentido o sacado el video con información falsa de Joe Biden. Así, la pregunta sobre lo que realmente se está haciendo contra este tipo de videos aún sigue en el aire, y la situación resulta aún incierta.